నుండి పరిశోధకులు టోక్యో యూనివర్సిటీ ఆఫ్ సైన్స్ (TUS) పెద్ద-స్థాయి AI మోడల్లను నిర్దిష్ట తరగతుల డేటాను “మరచిపోవడానికి” ఎనేబుల్ చేయడానికి ఒక పద్ధతిని అభివృద్ధి చేసింది.

AIలో పురోగతి ఆరోగ్య సంరక్షణ నుండి స్వయంప్రతిపత్త డ్రైవింగ్ వరకు వివిధ డొమైన్లను విప్లవాత్మకంగా మార్చగల సాధనాలను అందించింది. అయితే, సాంకేతికత అభివృద్ధి చెందుతున్న కొద్దీ, దాని సంక్లిష్టతలు మరియు నైతిక పరిగణనలు కూడా పెరుగుతాయి.

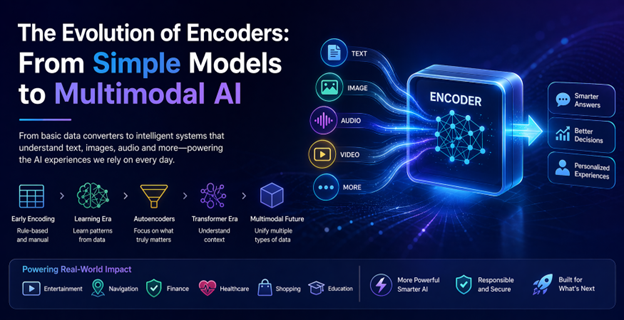

OpenAI యొక్క ChatGPT వంటి భారీ-స్థాయి ముందస్తు శిక్షణ పొందిన AI సిస్టమ్ల నమూనా మరియు CLIP (కాంట్రాస్టివ్ లాంగ్వేజ్-ఇమేజ్ ప్రీ-ట్రైనింగ్), మెషీన్ల కోసం అంచనాలను పునర్నిర్మించింది. ఈ అత్యంత సాధారణ నమూనాలు, స్థిరమైన ఖచ్చితత్వంతో విస్తారమైన పనులను నిర్వహించగల సామర్థ్యాన్ని కలిగి ఉంటాయి, ఇవి వృత్తిపరమైన మరియు వ్యక్తిగత ఉపయోగం కోసం విస్తృతంగా స్వీకరించబడ్డాయి.

అయినప్పటికీ, అటువంటి బహుముఖ ప్రజ్ఞకు అధిక ధర వస్తుంది. ఈ మోడళ్లకు శిక్షణ ఇవ్వడం మరియు అమలు చేయడం కోసం అద్భుతమైన శక్తి మరియు సమయం అవసరం, స్థిరత్వ ఆందోళనలను పెంచుతుంది, అలాగే ప్రామాణిక కంప్యూటర్ల కంటే అత్యాధునిక హార్డ్వేర్ చాలా ఖరీదైనది. నిర్దిష్ట పనులకు వర్తింపజేసినప్పుడు సాధారణవాద ధోరణులు AI నమూనాల సామర్థ్యాన్ని అడ్డుకోవడమే ఈ సమస్యలను సమ్మిళితం చేస్తుంది.

ఉదాహరణకు, “ప్రాక్టికల్ అప్లికేషన్లలో, అన్ని రకాల ఆబ్జెక్ట్ క్లాస్ల వర్గీకరణ చాలా అరుదుగా అవసరం” అని పరిశోధనకు నాయకత్వం వహించిన అసోసియేట్ ప్రొఫెసర్ గో ఐరీ వివరించారు. “ఉదాహరణకు, స్వయంప్రతిపత్త డ్రైవింగ్ సిస్టమ్లో, కార్లు, పాదచారులు మరియు ట్రాఫిక్ సంకేతాలు వంటి పరిమిత తరగతుల వస్తువులను గుర్తించడం సరిపోతుంది.

“మేము ఆహారం, ఫర్నిచర్ లేదా జంతు జాతులను గుర్తించాల్సిన అవసరం లేదు. గుర్తించాల్సిన అవసరం లేని తరగతులను నిలుపుకోవడం వల్ల మొత్తం వర్గీకరణ ఖచ్చితత్వం తగ్గుతుంది, అలాగే గణన వనరుల వ్యర్థం మరియు సమాచారం లీకేజీ ప్రమాదం వంటి కార్యాచరణ ప్రతికూలతలకు కారణం కావచ్చు.

అనవసరమైన లేదా అనవసరమైన సమాచారాన్ని “మర్చిపోవడానికి” శిక్షణ నమూనాలలో సంభావ్య పరిష్కారం ఉంది-అవసరమైన వాటిపై మాత్రమే దృష్టి పెట్టడానికి వారి ప్రక్రియలను క్రమబద్ధీకరించడం. ఇప్పటికే ఉన్న కొన్ని పద్ధతులు ఇప్పటికే ఈ అవసరాన్ని తీరుస్తుండగా, మోడల్ యొక్క అంతర్గత నిర్మాణం మరియు పారామితులకు వినియోగదారులు ప్రాప్యతను కలిగి ఉన్న “వైట్-బాక్స్” విధానాన్ని వారు ఊహించుకుంటారు. అయితే, తరచుగా, వినియోగదారులు అలాంటి దృశ్యమానతను పొందలేరు.

“బ్లాక్-బాక్స్” AI వ్యవస్థలు, వాణిజ్య మరియు నైతిక పరిమితుల కారణంగా సర్వసాధారణం, వాటి అంతర్గత మెకానిజమ్లను దాచిపెట్టి, సంప్రదాయ మర్చిపోయే పద్ధతులను అసాధ్యమైనవిగా అందిస్తాయి. ఈ అంతరాన్ని పరిష్కరించడానికి, పరిశోధనా బృందం ఉత్పన్నం-రహిత ఆప్టిమైజేషన్ వైపు మొగ్గు చూపింది-ఇది మోడల్ యొక్క ప్రాప్యత చేయలేని అంతర్గత పనితీరుపై ఆధారపడటాన్ని పక్కదారి పట్టించే విధానం.

మర్చిపోవడం ద్వారా ముందుకు సాగుతున్నారు

2024లో జరిగే న్యూరల్ ఇన్ఫర్మేషన్ ప్రాసెసింగ్ సిస్టమ్స్ (NeurIPS) కాన్ఫరెన్స్లో ప్రదర్శించబడే ఈ అధ్యయనం, “బ్లాక్-బాక్స్ మర్చిపోవడం” అనే పద్దతిని పరిచయం చేసింది.

AI కొన్ని తరగతులను క్రమక్రమంగా “మర్చిపోవడానికి” పునరుక్తి రౌండ్లలో ఇన్పుట్ ప్రాంప్ట్లను (మోడళ్లకు అందించబడిన టెక్స్ట్ సూచనలు) ప్రక్రియ సవరిస్తుంది. అసోసియేట్ ప్రొఫెసర్ ఐరీ సహ రచయితలు యుసుకే కువానా మరియు యుటా గోటో (ఇద్దరూ TUS నుండి), డాక్టర్ తకాషి షిబాటాతో కలిసి పనిలో సహకరించారు. NEC కార్పొరేషన్.

వారి ప్రయోగాల కోసం, పరిశోధకులు చిత్ర వర్గీకరణ సామర్థ్యాలతో కూడిన విజన్-లాంగ్వేజ్ మోడల్ అయిన CLIPని లక్ష్యంగా చేసుకున్నారు. వారు అభివృద్ధి చేసిన పద్ధతి కోవేరియెన్స్ మ్యాట్రిక్స్ అడాప్టేషన్ ఎవల్యూషన్ స్ట్రాటజీ (CMA-ES)పై నిర్మించబడింది, ఇది దశల వారీ పరిష్కారాలను ఆప్టిమైజ్ చేయడానికి రూపొందించబడిన పరిణామ అల్గారిథమ్. ఈ అధ్యయనంలో, CLIPకి అందించబడిన ప్రాంప్ట్లను మూల్యాంకనం చేయడానికి మరియు మెరుగుపరచడానికి CMA-ES ఉపయోగించబడింది, చివరికి నిర్దిష్ట చిత్ర వర్గాలను వర్గీకరించే దాని సామర్థ్యాన్ని అణిచివేస్తుంది.

ప్రాజెక్ట్ పురోగతిలో, సవాళ్లు తలెత్తాయి. ఇప్పటికే ఉన్న ఆప్టిమైజేషన్ టెక్నిక్లు టార్గెటెడ్ కేటగిరీల యొక్క పెద్ద వాల్యూమ్ల కోసం స్కేల్ చేయడానికి చాలా కష్టపడ్డాయి, “గుప్త సందర్భ భాగస్వామ్యం” అని పిలువబడే ఒక నవల పారామెటరైజేషన్ వ్యూహాన్ని రూపొందించడానికి బృందానికి దారితీసింది.

ఈ విధానం గుప్త సందర్భాన్ని విచ్ఛిన్నం చేస్తుంది – ప్రాంప్ట్ల ద్వారా రూపొందించబడిన సమాచారం యొక్క ప్రాతినిధ్యం – చిన్న, మరింత నిర్వహించదగిన ముక్కలుగా. అనేక టోకెన్లలో ఇతరులను తిరిగి ఉపయోగిస్తున్నప్పుడు ఒకే టోకెన్ (పదం లేదా అక్షరం)కి నిర్దిష్ట మూలకాలను కేటాయించడం ద్వారా, అవి సమస్య యొక్క సంక్లిష్టతను నాటకీయంగా తగ్గించాయి. ముఖ్యంగా, ఇది విస్తృతమైన మరచిపోయే అప్లికేషన్ల కోసం కూడా ప్రక్రియను గణనపరంగా ట్రాక్ చేయదగినదిగా చేసింది.

మల్టిపుల్ ఇమేజ్ క్లాసిఫికేషన్ డేటాసెట్లపై బెంచ్మార్క్ పరీక్షల ద్వారా, పరిశోధకులు బ్లాక్-బాక్స్ మరచిపోవడం యొక్క సామర్థ్యాన్ని ధృవీకరించారు- AI మోడల్ యొక్క అంతర్గత నిర్మాణాన్ని నేరుగా యాక్సెస్ చేయకుండా CLIPని దాదాపు 40% లక్ష్య తరగతులను “మర్చిపోయేలా” చేసే లక్ష్యాన్ని సాధించారు.

ఈ పరిశోధన బ్లాక్-బాక్స్ విజన్-లాంగ్వేజ్ మోడల్లో సెలెక్టివ్ మర్చింగ్ని ప్రేరేపించే మొదటి విజయవంతమైన ప్రయత్నాన్ని సూచిస్తుంది, ఇది మంచి ఫలితాలను ప్రదర్శిస్తుంది.

AI మోడల్లు డేటాను మరచిపోయేలా చేయడం వల్ల కలిగే ప్రయోజనాలు

దాని సాంకేతిక చాతుర్యానికి మించి, ఈ ఆవిష్కరణ వాస్తవ-ప్రపంచ అనువర్తనాలకు గణనీయమైన సామర్థ్యాన్ని కలిగి ఉంది, ఇక్కడ విధి-నిర్దిష్ట ఖచ్చితత్వం చాలా ముఖ్యమైనది.

ప్రత్యేక టాస్క్ల కోసం నమూనాలను సరళీకృతం చేయడం వలన వాటిని వేగవంతంగా, మరింత వనరులు-సమర్థవంతంగా మరియు తక్కువ శక్తివంతమైన పరికరాల్లో అమలు చేయగల సామర్థ్యం కలిగి ఉంటుంది-గతంలో అసాధ్యమని భావించిన ప్రాంతాల్లో AI యొక్క స్వీకరణను వేగవంతం చేస్తుంది.

మరో కీలకమైన ఉపయోగం ఇమేజ్ జనరేషన్లో ఉంది, ఇక్కడ దృశ్యమాన సందర్భం యొక్క మొత్తం వర్గాలను మర్చిపోవడం వలన మోడల్లు అవాంఛనీయమైన లేదా హానికరమైన కంటెంట్ను అనుకోకుండా సృష్టించకుండా నిరోధించవచ్చు, అది అభ్యంతరకరమైన విషయం లేదా తప్పుడు సమాచారం కావచ్చు.

బహుశా చాలా ముఖ్యమైనది, ఈ పద్ధతి AI యొక్క గొప్ప నైతిక వివాదాలలో ఒకటి: గోప్యత.

AI నమూనాలు, ప్రత్యేకించి పెద్ద-స్థాయి ఉన్నవి, తరచుగా భారీ డేటాసెట్లపై శిక్షణ పొందుతాయి, అవి అనుకోకుండా సున్నితమైన లేదా పాత సమాచారాన్ని కలిగి ఉంటాయి. అటువంటి డేటాను తీసివేయాలనే అభ్యర్థనలు-ముఖ్యంగా “మరచిపోయే హక్కు” కోసం వాదించే చట్టాల వెలుగులో-గణనీయ సవాళ్లను కలిగిస్తాయి.

సమస్యాత్మక డేటాను మినహాయించడానికి మొత్తం మోడళ్లకు మళ్లీ శిక్షణ ఇవ్వడం ఖర్చుతో కూడుకున్నది మరియు సమయంతో కూడుకున్నది, అయినప్పటికీ దాన్ని అడ్రస్ చేయకుండా వదిలేయడం వల్ల కలిగే నష్టాలు చాలా విస్తృతమైన పరిణామాలను కలిగి ఉంటాయి.

అసోసియేట్ ప్రొఫెసర్ ఐరీ ఇలా పేర్కొన్నాడు, “పెద్ద-స్థాయి మోడల్కు మళ్లీ శిక్షణ ఇవ్వడానికి అపారమైన శక్తి ఖర్చవుతుంది. “‘సెలెక్టివ్ మర్చింగ్,’ లేదా మెషిన్ అన్లెర్నింగ్ అని పిలవబడేవి, ఈ సమస్యకు సమర్థవంతమైన పరిష్కారాన్ని అందించవచ్చు.”

ఈ గోప్యత-కేంద్రీకృత అప్లికేషన్లు ముఖ్యంగా ఆరోగ్య సంరక్షణ మరియు ఫైనాన్స్ వంటి అధిక-స్టేక్స్ పరిశ్రమలలో సంబంధితంగా ఉంటాయి, ఇక్కడ సెన్సిటివ్ డేటా కార్యకలాపాలకు కేంద్రంగా ఉంటుంది.

AIని పురోగమింపజేయడానికి గ్లోబల్ రేస్ వేగవంతమవుతున్నందున, టోక్యో యూనివర్శిటీ ఆఫ్ సైన్స్ యొక్క బ్లాక్-బాక్స్ మర్చిపోయే విధానం ఒక ముఖ్యమైన మార్గాన్ని చూపుతుంది-సాంకేతికతను మరింత అనుకూలమైనది మరియు సమర్థవంతమైనదిగా చేయడం ద్వారా మాత్రమే కాకుండా వినియోగదారులకు ముఖ్యమైన రక్షణలను జోడించడం ద్వారా కూడా.

దుర్వినియోగానికి సంభావ్యత మిగిలి ఉన్నప్పటికీ, సెలెక్టివ్ మర్చింగ్ వంటి పద్ధతులు పరిశోధకులు నైతిక మరియు ఆచరణాత్మక సవాళ్లను ముందుగానే పరిష్కరిస్తున్నారని నిరూపిస్తున్నాయి.

ఇవి కూడా చూడండి: QwQ-32B-ప్రివ్యూ ఎందుకు చూడాలనే తార్కిక AI

పరిశ్రమ ప్రముఖుల నుండి AI మరియు పెద్ద డేటా గురించి మరింత తెలుసుకోవాలనుకుంటున్నారా? తనిఖీ చేయండి AI & బిగ్ డేటా ఎక్స్పో ఆమ్స్టర్డామ్, కాలిఫోర్నియా మరియు లండన్లో జరుగుతున్నాయి. సమగ్ర ఈవెంట్తో సహా ఇతర ప్రముఖ ఈవెంట్లతో కలిసి ఉంది ఇంటెలిజెంట్ ఆటోమేషన్ కాన్ఫరెన్స్, బ్లాక్ ఎక్స్, డిజిటల్ ట్రాన్స్ఫర్మేషన్ వీక్మరియు సైబర్ సెక్యూరిటీ & క్లౌడ్ ఎక్స్పో.

TechForge ద్వారా అందించబడే ఇతర రాబోయే ఎంటర్ప్రైజ్ టెక్నాలజీ ఈవెంట్లు మరియు వెబ్నార్లను అన్వేషించండి ఇక్కడ.