OpenAI యొక్క రక్షణ ప్రక్రియలో కీలకమైన భాగం “రెడ్ టీమింగ్” — కొత్త సిస్టమ్లలో సంభావ్య ప్రమాదాలు మరియు దుర్బలత్వాలను అన్వేషించడానికి మానవ మరియు AI పాల్గొనేవారిని ఉపయోగించే నిర్మాణాత్మక పద్దతి.

చారిత్రాత్మకంగా, OpenAI ప్రధానంగా మాన్యువల్ టెస్టింగ్ ద్వారా రెడ్ టీమింగ్ ప్రయత్నాలలో నిమగ్నమై ఉంది, ఇందులో బలహీనతలను పరిశీలించే వ్యక్తులు ఉంటారు. 2022 ప్రారంభంలో వారి DALL·E 2 ఇమేజ్ జనరేషన్ మోడల్ను పరీక్షించేటప్పుడు ఇది ప్రత్యేకంగా ఉపయోగించబడింది, ఇక్కడ సంభావ్య ప్రమాదాలను గుర్తించడానికి బాహ్య నిపుణులు ఆహ్వానించబడ్డారు. అప్పటి నుండి, OpenAI మరింత సమగ్రమైన ప్రమాద అంచనా కోసం స్వయంచాలక మరియు మిశ్రమ విధానాలను కలుపుతూ దాని పద్దతులను విస్తరించింది మరియు మెరుగుపరచింది.

“మోడల్ తప్పుల ఆవిష్కరణను కొలవడానికి మేము మరింత శక్తివంతమైన AIని ఉపయోగించగలమని మేము ఆశాజనకంగా ఉన్నాము” అని OpenAI పేర్కొంది. స్వయంచాలక ప్రక్రియలు మోడళ్లను మూల్యాంకనం చేయడంలో సహాయపడతాయని మరియు నమూనాలు మరియు లోపాలను పెద్ద స్థాయిలో గుర్తించడం ద్వారా వాటిని సురక్షితంగా ఉండేలా శిక్షణ ఇవ్వగలదనే ఆలోచనలో ఈ ఆశావాదం పాతుకుపోయింది.

పురోగతి కోసం వారి తాజా పుష్లో, OpenAI రెడ్ టీమింగ్పై రెండు ముఖ్యమైన పత్రాలను పంచుకుంటుంది – బాహ్య నిశ్చితార్థం వ్యూహాలను వివరించే శ్వేతపత్రం మరియు ఆటోమేటెడ్ రెడ్ టీమింగ్ కోసం ఒక నవల పద్ధతిని పరిచయం చేసే పరిశోధనా అధ్యయనం. ఈ రచనలు రెడ్ టీమింగ్ యొక్క ప్రక్రియ మరియు ఫలితాలను బలోపేతం చేయడం లక్ష్యంగా పెట్టుకున్నాయి, చివరికి సురక్షితమైన మరియు మరింత బాధ్యతాయుతమైన AI అమలులకు దారితీస్తాయి.

AI అభివృద్ధి చెందుతూనే ఉన్నందున, వినియోగదారు అనుభవాలను అర్థం చేసుకోవడం మరియు దుర్వినియోగం మరియు దుర్వినియోగం వంటి ప్రమాదాలను గుర్తించడం పరిశోధకులు మరియు డెవలపర్లకు కీలకం. రెడ్ టీమింగ్ ఈ రిస్క్లను మూల్యాంకనం చేయడానికి ఒక చురుకైన పద్ధతిని అందిస్తుంది, ప్రత్యేకించి స్వతంత్ర బాహ్య నిపుణుల శ్రేణి నుండి అంతర్దృష్టులతో అనుబంధంగా ఉన్నప్పుడు. ఈ విధానం బెంచ్మార్క్లను స్థాపించడంలో సహాయపడటమే కాకుండా కాలక్రమేణా భద్రతా మూల్యాంకనాలను మెరుగుపరచడంలో కూడా సహాయపడుతుంది.

మానవ స్పర్శ

OpenAI వారి శ్వేతపత్రంలో నాలుగు ప్రాథమిక దశలను పంచుకుంది, “AI మోడల్స్ మరియు సిస్టమ్స్ కోసం బాహ్య రెడ్ టీమింగ్కు OpenAI యొక్క అప్రోచ్,” సమర్థవంతమైన రెడ్ టీమింగ్ ప్రచారాలను రూపొందించడానికి:

- ఎరుపు జట్ల కూర్పు: జట్టు సభ్యుల ఎంపిక ప్రచారం యొక్క లక్ష్యాలపై ఆధారపడి ఉంటుంది. ఇది తరచుగా సహజ శాస్త్రాలు, సైబర్ భద్రత మరియు ప్రాంతీయ రాజకీయాలలో నైపుణ్యం వంటి విభిన్న దృక్కోణాలు కలిగిన వ్యక్తులను కలిగి ఉంటుంది, మూల్యాంకనాలు అవసరమైన విస్తృతిని కలిగి ఉంటాయి.

- మోడల్ వెర్షన్లకు యాక్సెస్: మోడల్ రెడ్ టీమర్ల ఏ వెర్షన్లను యాక్సెస్ చేయాలో స్పష్టం చేయడం ఫలితాలను ప్రభావితం చేస్తుంది. ప్రారంభ-దశ నమూనాలు స్వాభావిక ప్రమాదాలను బహిర్గతం చేయవచ్చు, అయితే మరింత అభివృద్ధి చెందిన సంస్కరణలు ప్రణాళికాబద్ధమైన భద్రతా ఉపశమనాలలో అంతరాలను గుర్తించడంలో సహాయపడతాయి.

- మార్గదర్శకత్వం మరియు డాక్యుమెంటేషన్: ప్రచారాల సమయంలో ప్రభావవంతమైన పరస్పర చర్యలు స్పష్టమైన సూచనలు, తగిన ఇంటర్ఫేస్లు మరియు నిర్మాణాత్మక డాక్యుమెంటేషన్పై ఆధారపడతాయి. ఇందులో మోడల్లు, ఇప్పటికే ఉన్న రక్షణలు, టెస్టింగ్ ఇంటర్ఫేస్లు మరియు రికార్డింగ్ ఫలితాల కోసం మార్గదర్శకాలను వివరించడం ఉంటుంది.

- డేటా సంశ్లేషణ మరియు మూల్యాంకనం: ప్రచారం తర్వాత, ఉదాహరణలు ఇప్పటికే ఉన్న విధానాలకు అనుగుణంగా ఉన్నాయా లేదా కొత్త ప్రవర్తనా మార్పులు అవసరమా అని నిర్ధారించడానికి డేటా అంచనా వేయబడుతుంది. అంచనా వేయబడిన డేటా భవిష్యత్తులో నవీకరణల కోసం పునరావృతమయ్యే మూల్యాంకనాలను తెలియజేస్తుంది.

ఈ పద్దతి యొక్క ఇటీవలి అప్లికేషన్ OpenAIని సిద్ధం చేసింది o1 కుటుంబం ప్రజల ఉపయోగం కోసం నమూనాల యొక్క – సంభావ్య దుర్వినియోగానికి వాటి నిరోధకతను పరీక్షించడం మరియు వాస్తవ-ప్రపంచ దాడి ప్రణాళిక, సహజ శాస్త్రాలు మరియు AI పరిశోధన వంటి వివిధ రంగాలలో వాటి అప్లికేషన్ను మూల్యాంకనం చేయడం.

స్వయంచాలక రెడ్ టీమింగ్

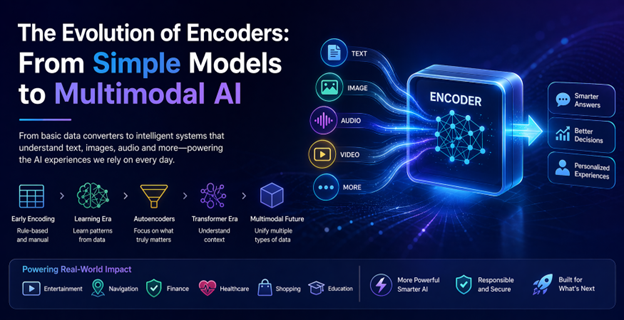

ఆటోమేటెడ్ రెడ్ టీమింగ్ AI విఫలమయ్యే సందర్భాలను గుర్తించడానికి ప్రయత్నిస్తుంది, ముఖ్యంగా భద్రత-సంబంధిత సమస్యలకు సంబంధించి. ఈ పద్ధతి స్కేల్లో అత్యుత్తమంగా ఉంటుంది, సంభావ్య లోపాల యొక్క అనేక ఉదాహరణలను త్వరగా ఉత్పత్తి చేస్తుంది. అయినప్పటికీ, సాంప్రదాయిక స్వయంచాలక విధానాలు విభిన్నమైన, విజయవంతమైన దాడి వ్యూహాలను ఉత్పత్తి చేయడంలో పోరాడుతున్నాయి.

OpenAI పరిశోధన పరిచయం చేసింది “ఆటో-జెనరేటెడ్ రివార్డ్లు మరియు మల్టీ-స్టెప్ రీన్ఫోర్స్మెంట్ లెర్నింగ్తో విభిన్నమైన మరియు ప్రభావవంతమైన రెడ్ టీమింగ్,” ప్రభావాన్ని కొనసాగించేటప్పుడు దాడి వ్యూహాలలో ఎక్కువ వైవిధ్యాన్ని ప్రోత్సహించే పద్ధతి.

ఈ పద్ధతిలో అక్రమ సలహా వంటి విభిన్న దృశ్యాలను రూపొందించడానికి AIని ఉపయోగించడం మరియు ఈ దృశ్యాలను విమర్శనాత్మకంగా అంచనా వేయడానికి రెడ్ టీమింగ్ మోడల్లకు శిక్షణ ఇవ్వడం వంటివి ఉంటాయి. ఈ ప్రక్రియ వైవిధ్యం మరియు సమర్ధతకు రివార్డ్ చేస్తుంది, మరింత వైవిధ్యమైన మరియు సమగ్రమైన భద్రతా మూల్యాంకనాలను ప్రోత్సహిస్తుంది.

దాని ప్రయోజనాలు ఉన్నప్పటికీ, రెడ్ టీమింగ్కు పరిమితులు ఉన్నాయి. ఇది ఒక నిర్దిష్ట సమయంలో ప్రమాదాలను సంగ్రహిస్తుంది, ఇది AI నమూనాలు అభివృద్ధి చెందుతున్నప్పుడు అభివృద్ధి చెందుతుంది. అదనంగా, రెడ్ టీమింగ్ ప్రక్రియ అనుకోకుండా సమాచార ప్రమాదాలను సృష్టించగలదు, ఇంకా విస్తృతంగా తెలియని దుర్బలత్వాల గురించి హానికరమైన నటులను హెచ్చరిస్తుంది. ఈ ప్రమాదాలను నిర్వహించడానికి కఠినమైన ప్రోటోకాల్లు మరియు బాధ్యతాయుతమైన బహిర్గతం అవసరం.

రిస్క్ డిస్కవరీ మరియు మూల్యాంకనంలో రెడ్ టీమింగ్ కీలకంగా కొనసాగుతున్నప్పటికీ, సాంకేతికత సామాజిక విలువలు మరియు అంచనాలకు అనుగుణంగా ఉండేలా AI యొక్క ఆదర్శ ప్రవర్తనలు మరియు విధానాలపై విస్తృత ప్రజా దృక్పథాలను చేర్చడం యొక్క ఆవశ్యకతను OpenAI గుర్తించింది.

ఇవి కూడా చూడండి: EU AI మోడల్ల కోసం డ్రాఫ్ట్ రెగ్యులేటరీ గైడెన్స్ను పరిచయం చేసింది

పరిశ్రమ ప్రముఖుల నుండి AI మరియు పెద్ద డేటా గురించి మరింత తెలుసుకోవాలనుకుంటున్నారా? తనిఖీ చేయండి AI & బిగ్ డేటా ఎక్స్పో ఆమ్స్టర్డామ్, కాలిఫోర్నియా మరియు లండన్లో జరుగుతున్నాయి. సమగ్ర ఈవెంట్ సహా ఇతర ప్రముఖ ఈవెంట్లతో సహ-స్థానంలో ఉంది ఇంటెలిజెంట్ ఆటోమేషన్ కాన్ఫరెన్స్, బ్లాక్ ఎక్స్, డిజిటల్ ట్రాన్స్ఫర్మేషన్ వీక్మరియు సైబర్ సెక్యూరిటీ & క్లౌడ్ ఎక్స్పో.

TechForge ద్వారా అందించబడే ఇతర రాబోయే ఎంటర్ప్రైజ్ టెక్నాలజీ ఈవెంట్లు మరియు వెబ్నార్లను అన్వేషించండి ఇక్కడ.